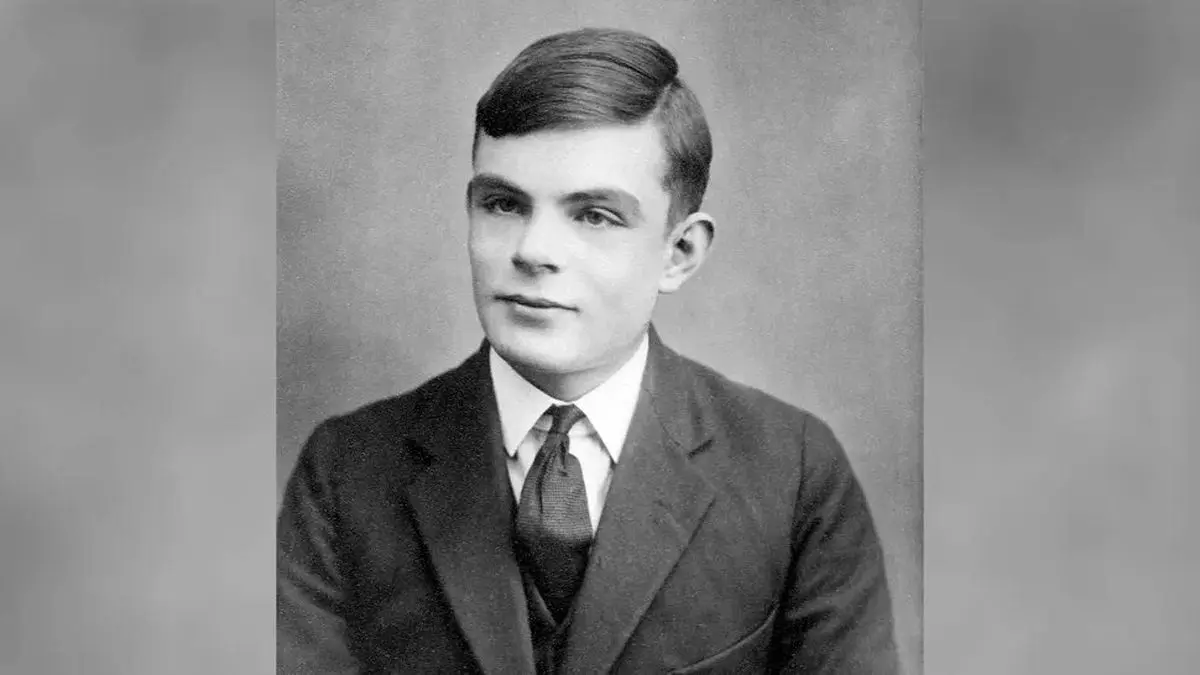

هوش مصنوعی «بازی تقلید» را برد / تشخیص دادن انسان از ماشین غیرممکن میشود

مدلهای زبانی بزرگ هر روز بهتر از دیروز رفتار انسان را تقلید میکنند و اکنون توانستهاند از عهده قبولی در آزمون مشهور تورینگ برآیند.

مدل زبانی «GPT-4.5» توانست آزمون تورینگ را بدون اشتباه پشت سر بگذارد. در پژوهشی که نتایج آن در پایگاه داده «arXiv» منتشر شده است، «GPT-4.5» در یک آزمون سه طرفه تورینگ شرکت کرد و در کمال شگفتی در بیش از ۷۳ درصد موارد توانست مردم را قانع کند که انسان است.

این پژوهش هنوز داوری همتا «peer review» نشده است. دانشمندان حوزه هوش مصنوعی تعدادی از مدلهای هوش مصنوعی متفاوت را در این پژوهش مورد بررسی قرار دادند.

پیش از این نیز گزارش شده بود که مدل زبانی «GPT-4» توانسته بود که آزمون دو طرفه تورینگ را پشت سر بگذارد اما این نخستین باری است که یک مدل زبانی بزرگ میتواند از عهده «بازی تقلید» با پیکربندی اصلی برآید.

در این پژوهش مدل زبانی «GPT-4.5» پیشتاز بود اما مدل زبانی کمپانی متا با نام «LLaMa-3.1» نیز در ۵۶ درصد موارد توانست شرکتکنندگان را قانع کند که انسان است.

ایده اصلی آزمون تورینگ درباره اثبات توانایی ماشین در اندیشیدن نیست بلکه تاکید آزمون بر توانایی تقلید موفق ماشین از انسان است. از این رو آزمون تورینگ به «بازی تقلید» شهرت دارد.

در آزمون اصلی تورینگ، شرکتکننده باید سوالاتی را از دو موجودیت، یکی انسان و دیگر کامپیوتر، بپرسد. در پی چندین پرسش و پاسخ، شرکتکننده باید تشخیص دهد که کدام موجودیت انسان و کدامیک کامپیوتر است. کامپیوتر یا سیستم هوش مصنوعی اکنون میتواند با تقلیدی شگفتانگیز خودش را جای انسان جا بزند.

هنگامی که از شرکتکنندگان در آزمون پرسیدند که چرا یک موجودیت را هوش مصنوعی یا انسان انتخاب کردند، آنها فاکتورهایی چون سبک صحبت کردن، جریان گفتگو و عواملی چون شخصیت را مد نظر داشتند.

این پژوهش نقطه عطفی تازه برای مدلهای زبانی بزرگ است. البته برای نتیجهگیری باید احتیاط کرد چرا که از سر گذراندن «بازی تقلید» نشاندهنده هوش واقعی انسان نیست اما نشان میدهد که سیستمهای هوش مصنوعی جدید تا چه اندازه در تقلید از انسان دقیق هستند.

روی تاریک این توانایی را میتوان در سوءاستفاده از احساسات و مهندسی اجتماعی با تقلید رفتارهای انسان دید که میتواند زنگ خطر را برای بسیاری به صدا درآورد.

هشدار بزرگ اینجاست: «برخی از بدترین آسیبها زمانی رخ میدهد که مردم متوجه نیستند که با یک مدل زبانی طرف هستند نه یک انسان.»